Mục tiêu: cung cấp cái nhìn tổng quan và ơ bản về những gì đang diễn ra trong quản trị AI dài hạn (longtermist AI governance).

Đối tượng: những người có kiến thức hạn chế về quản trị AI dài hạn và muốn hiểu rõ hơn về lĩnh vực này.Tôi không mong bài viết này sẽ hữu ích cho những người đã quen thuộc với lĩnh vực này. Một số người đã khá quen thuộc với lĩnh vực vẫn thấy bài viết này hữu ích.

Bài viết này phác thảo các loại công việc khác nhau đang diễn ra trong quản trị AI dài hạn. Đối với mỗi loại công việc, tôi sẽ giải thích, đưa ra ví dụ, phác thảo một số câu chuyện về cách nó có thể tạo ra tác động tích cực và liệt kê những cá nhân mà tôi biết hiện đang làm việc trong lĩnh vực này.[1]

Đầu tiên, đây là một số định nghĩa:

Điều đáng chú ý là lĩnh vực quản trị AI dài hạn còn hạn chế. Tôi đoán chỉ có khoảng 60 người làm việc trong lĩnh vực quản trị AI xuất phát từ động lực quan ngại đến tầm ảnh hưởng rất dài hạn của AI.

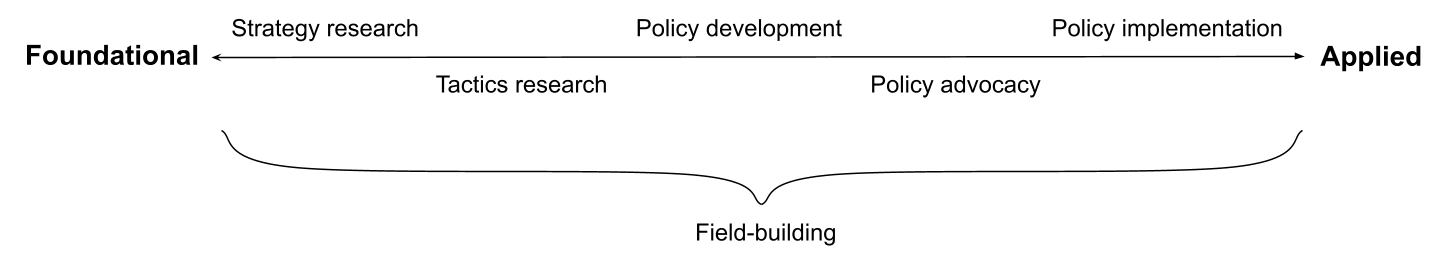

Ở cấp độ cao, tôi thấy hữu ích khi xem xét sự khác biệt giữa công việc nền tảng và công việc ứng dụng. Ở cấp độ nền tảng, có nghiên cứu chiến lược, nhằm xác định các mục tiêu cấp cao phù hợp với quản trị AI dài hạn; sau đó là nghiên cứu chiến thuật, nhằm xác định các kế hoạch giúp đạt được các mục tiêu cấp cao đó. Tiến tới khía cạnh ứng dụng, gồm có việc phát triển chính sách, lấy nghiên cứu ứng dụng này và diễn dịch thành chính sách cụ thể; việc vận động (advocacy) thực hiện các chính sách đó, và cuối cùng là thực thi thực tế các chính sách đó (bởi các công chức).

Ngoài ra còn có việc xây nền cho lĩnh vực (không phân rõ được là thuộc về phía nào trong phổ trên). Thay vì đóng góp trực tiếp vào vấn đề, công việc này nhằm xây dựng một vùng làm việc (field) cho những người đang làm công việc có giá trị trong lĩnh vực này.

Tất nhiên, phân loại này là đơn giản hóa và không phải tất cả công việc đều phù hợp hoàn toàn với một phân loại duy nhất.

Bạn có thể nghĩ rằng những hiểu biết sâu sắc chủ yếu chảy từ đầu cơ bản hơn đến đầu ứng dụng hơn của dải phạm vi trên, nhưng điều quan trọng là nghiên cứu phải nhạy cảm với các vấn đề chính sách, ví dụ như xem xét khả năng nghiên cứu của bạn có thể cung cấp thông tin cho một đề xuất chính sách khả thi về mặt chính trị hay không.

Bây giờ chúng ta sẽ xem xét chi tiết hơn từng loại công việc này.

Mục đich tối hậu khi nghiên cứu chiến lược AI dài hạn (Longtermist AI strategy research) là nhằm xác định các mục tiêu cấp cao mà chúng ta có thể theo đuổi, mà nếu đạt được thì rõ ràng sẽ tăng cơ hội đạt được kết quả tốt từ AI tiên tiến (mà thi thoảng tôi sẽ nói như Muehlhauser là xét từ góc độ dài hạn, mục tiêu này gọi là 'đạt được sự rõ ràng mang tính chiến lược').

Nghiên cứu này có thể khác nhau trên một phổ giữa có mục tiêu và khám phá như sau:

Rất dễ nhầm lẫn nghiên cứu chiến lược (và đặc biệt là nghiên cứu chiến lược thăm dò) với nghiên cứu phạm vi rộng. Như nhiều ví dụ trên cho thấy, nghiên cứu chiến lược có thể có phạm vi hẹp, tức là nó có thể trả lời một câu hỏi khá hẹp. Ví dụ về câu hỏi có phạm vi rộng và hẹp:

Thật vậy, tôi nghĩ rằng tốt hơn là chọn các câu hỏi có phạm vi hẹp, đặc biệt là đối với các nhà nghiên cứu mới, vì chúng có xu hướng dễ giải quyết hơn.

Luke Muehlhauser có một số khuyến nghị cho những ai muốn thử loại công việc này: xem điểm 4 trong bài viết này. Và xem bài viết này để biết một số ví dụ về các câu hỏi nghiên cứu mở.[3]

Một số người tại các tổ chức sau: FHI, GovAI, CSER, DeepMind, OpenAI, GCRI, CLR, Rethink Priorities, OpenPhil, CSET,[4] cùng một số học giả độc lập.

Nghiên cứu chiến thuật AI dài hạn cuối cùng nhằm xác định kế hoạch giúp đạt được các mục tiêu cấp cao (mà nghiên cứu chiến lược đã xác định là ưu tiên). Nó có xu hướng có phạm vi hẹp hơn về bản chất.

Điều đáng chú ý là có thể có những lý do để thực hiện nghiên cứu chiến thuật ngay cả khi bạn chưa xác định rõ mục tiêu nào là ưu tiên: để học hỏi, tích lũy vốn nghề nghiệp và giúp xây dựng lĩnh vực học thuật.

Một số người tại các tổ chức sau: FHI, GovAI, CSER, DeepMind, OpenAI, GCRI, CSET, Rethink Priorities, LPP, cùng một số học giả độc lập.

Nghiên cứu chiến lược xác định các mục tiêu cấp cao. Nghiên cứu chiến thuật lấy các mục tiêu đó và lập kế hoạch để đạt được chúng. Công tác phát triển chính sách lấy các kế hoạch đó và chuyển đổi chúng thành các khuyến nghị chính sách sẵn sàng trình lên các nhà hoạch định chính sách. Điều này đòi hỏi phải xác định (ví dụ) yêu cầu cụ thể nào cần đưa ra, ngôn ngữ sử dụng (cả trong văn bản chính sách chính thức và trong yêu cầu), cùng các yếu tố cụ thể khác của bối cảnh sẽ ảnh hưởng đến khả năng triển khai thành công.

Vận động chính sách là việc vận động để các chính sách được thực hiện, ví dụ như xác định ai là người phù hợp nhất để đưa ra yêu cầu chính sách, gửi đến ai và vào thời điểm nào.

Thực thi chính sách là công việc thực hiện các chính sách trong thực tế, do cán bộ công chức hoặc các doanh nghiệp thực hiện.

Cần phân biệt chính sách của chính phủ (tức là chính sách dự định được ban hành bởi chính phủ hoặc các tổ chức liên chính phủ) với chính sách của doanh nghiệp (tức là chính sách dự định được áp dụng bởi các doanh nghiệp). Một số người làm việc trong lĩnh vực quản trị AI dài hạn tập trung vào việc cải thiện chính sách của doanh nghiệp (đặc biệt là chính sách của các nhà phát triển AI), trong khi những người khác trong lĩnh vực này tập trung vào việc cải thiện chính sách của các chính phủ có liên quan.

Động lực chung cho tất cả các công việc chính sách là chi tiết thực thi thường được coi là yếu tố quan trọng để hoạch định chính sách thành công. Ví dụ, nếu một quy định của chính phủ có lỗ hổng nhỏ, điều đó có thể khiến quy định đó trở nên vô dụng.

So với nghiên cứu, loại công việc này có xu hướng liên quan đến tư duy cá nhân tương đối ít hơn, và tương đối nhiều hơn về đối thoại/thu thập thông tin (ví dụ: tổ chức các cuộc họp để tìm hiểu ai có quyền quyết định chính sách, họ quan tâm đến điều gì, và các bên khác muốn gì trong chính sách) cũng như phối hợp (ví dụ: tìm ra cách để một nhóm cá nhân ủng hộ một chính sách, và sau đó thực hiện điều đó).

Như đã đề cập trước đó, hiểu biết về chính sách đôi khi diễn ra theo chiều “ngược lại”. Ví dụ, việc xây dựng chính sách có thể được thực hiện lặp đi lặp lại dựa trên cách vận động thay đổi kiến thức của bạn (và bối cảnh chính sách).

Các ý tưởng này đa dạng và trải dải trên phổ (nghiên cứu), từ những ý tưởng có mục tiêu cụ thể hơn (ví dụ như không tích hợp AI vào NC3) đến những ý tưởng chung chung hơn (theo nghĩa tạo ra năng lực chung để đối phó với một loạt các vấn đề có thể phát sinh, ví dụ như hầu hết các ý tưởng khác ở trên). Tôi nghĩ rằng việc phát triển, vận động và thực thi chính sách của chúng ta hiện nay nên tập trung chủ yếu vào các ý tưởng chung chung hơn, do chúng ta chưa chắc chắn về cách AI sẽ phát triển (đồng thời thúc đẩy các ý tưởng cụ thể rõ ràng là tốt, khi chúng xuất hiện).

Mục đích rõ ràng của công việc này là phát triển lĩnh vực hoặc cộng đồng những người đang làm công việc có giá trị trong quản trị AI dài hạn.[6] Có thể coi công việc này bao gồm cả (1) thu hút người mới và (2) làm cho lĩnh vực này hiệu quả hơn.

GovAI, OpenPhil, SERI, CERI, CHERI và EA Cambridge. Từ góc độ rộng hơn, tất cả các phong trào EA vì mục đích chung cũng đang xây dựng việc này. Đây là loại công việc ít được khám phá nhất thảo luận nhất trong bài viết này.

Tôi chỉ trình bày một quan điểm khả thi về bối cảnh quản trị AI dài hạn - rõ ràng còn có những quan điểm khác, có thể hữu ích hơn cho các mục đích khác. Ví dụ, bạn có thể phân chia bối cảnh dựa trên các loại can thiệp khác nhau, chẳng hạn như:

Hoặc, bạn có thể phân chia theo trung tâm địa lý (mặc dù không phải tất cả các tổ chức đều thuộc một trung tâm địa lý):

Hoặc, bạn có thể phân chia bức tranh dựa trên các "lý thuyết về chiến thắng"(theories of victory), tức là những câu chuyện hoàn chỉnh về cách nhân loại thành công trong việc chuyển đổi sang một thế giới có AI tiên tiến. Có rất nhiều điều có thể nói thêm về tất cả những điều này; mục tiêu của bài viết này chỉ là cung cấp một cái nhìn tổng quan ngắn gọn về các loại công việc đang được thực hiện hiện nay.

Lời cảm ơn: đây là tổng hợp của riêng tôi về bối cảnh hiện tại, nhưng được lấy cảm hứng và/hoặc trích dẫn trực tiếp từ các bài đăng trên diễn đàn EA của Allan Dafoe, Luke Muehlhauser và Convergence Analysis. Cảm ơn Jess Whittlestone vì cuộc trò chuyện hữu ích, Matthijs Maas, Yun Gu, Konstantin Pilz, Caroline Baumöhl và đặc biệt là một người phản biện từ SERI vì những phản hồi về bản thảo.

Tác phẩm này được cấp phép theo Giấy phép Creative Commons Attribution 4.0 International.

Nếu bạn quan tâm đến việc tìm hiểu cách làm nhiều điều tốt hơn, đây là một số bước tiếp theo bạn có thể thực hiện.

Khám phá các ý tưởng và hành động thực tiễn để tạo ra tác động tích cực.

Địa điểm: Trường Đại học Kinh tế - Tài chính Thành phố Hồ Chí Minh, Cơ sở chính 141 - 145 Điện Biên Phủ, Phường Gia Định, Thành phố Hồ Chí Minh.

Thời gian: 9:00 - 17:00 ngày 11/07/2026

Thiện nguyện Hiệu quả là nỗ lực tìm kiếm những phương pháp giúp đỡ tốt nhất và áp dụng chúng vào thực tế.

Về cơ bản, Thiện nguyện Hiệu quả gồm hai phương diện: một là triết lý hướng đến việc tìm cách giúp đỡ hiệu quả nhất, và hai là một cộng đồng hành động, nơi mọi người cùng nhau áp dụng các kết quả nghiên cứu để khiến thế giới tốt đẹp hơ

Đọc thêm: Giới thiệu về thiện nguyện hiệu quả

Thiện nguyện hiệu quả tập trung vào việc cải thiện cuộc sống (bao gồm cả con người, động vật không phải người và những người trong các thế hệ tương lai). Hầu hết mọi người sẽ đồng ý rằng, nếu mọi yếu tố khác như nhau, việc giảm đau khổ và tăng cường phúc lợi là điều tốt. Cũng có thể có những thứ khác có giá trị - quảng bá nghệ thuật, hoặc bảo tồn môi trường tự nhiên - nhưng thiện nguyện hiệu quả chỉ xem xét những điều này trong chừng mực chúng cải thiện cuộc sống.

Có thể khó để so sánh một cách khách quan các lợi ích khác nhau mà những người khác nhau nhận được, hoặc bởi động vật thuộc các loài khác nhau, nhưng chúng tôi cố gắng trung lập nhất có thể khi làm điều đó.

Có thể bạn đồng tình với nguyên tắc chung của Thiện nguyện Hiệu quả (đó là tìm kiếm và ưu tiên những cách làm điều tốt hiệu quả nhất), nhưng lại cho rằng một vài đề xuất thực tế của phong trào là chưa đúng đắn, vì các biện pháp can thiệp, tổ chức từ thiện hay con đường sự nghiệp được gợi ý không mang lại hiệu quả thật sự.

Tinh thần của Thiện nguyện Hiệu quả là luôn cởi mở và sẵn sàng tiếp thu những lập luận thuyết phục cùng những bằng chứng vững chắc. Nếu bạn có lý do chính đáng để phản biện lại những phương pháp đang được xem là hiệu quả, hoặc có một đề xuất mới, bạn nên thảo luận với mọi người trong cộng đồng — đó chính là cách bạn giúp những người khác hành động hiệu quả hơn.

Đọc thêm:

Khác biệt giữa "không đồng ý về những gì hiệu quả" và "không đồng ý với Thiện nguyện Hiệu quả"

The difference between disagreeing about what’s effective and disagreeing with effective altruism

Có thể là vậy.

Mỗi chúng ta đều có rất nhiều cách để tạo ra sự thay đổi (qua các lĩnh vực hoạt động, con đường sự nghiệp, hay tổ chức từ thiện khác nhau). Sẽ có những hành động mang lại hiệu quả vượt trội hơn hẳn những hành động khác. Nếu bạn chưa thực sự chủ động tìm kiếm và lựa chọn phương án có tác động lớn nhất, thì thật khó để bạn có thể tình cờ chọn được cách làm tốt nhất. Bởi vì ngay cả khi bạn dành rất nhiều thời gian để nghiên cứu, việc tìm ra lựa chọn tối ưu vốn đã không hề dễ dàng.

Vì vậy, dù bạn đang làm bất cứ điều gì, bạn vẫn có thể tạo ra nhiều giá trị tốt đẹp hơn nữa nếu bạn chịu khó đánh giá, so sánh một cách kỹ lưỡng các phương án khác nhau và chọn ra phương án tốt nhất.

Đọc thêm:

- Một số vấn đề hiệu quả hơn những vấn đề khác (https://80000hours.org/articles/effective-or-not/)

Không hẳn. Nhưng nếu các yếu tố khác là như nhau, một phương pháp có xác suất thành công cao hơn thì vẫn tốt hơn.Một số người có xu hướng ưu tiên các phương pháp có bằng chứng thực nghiệm vững chắc, và thường hoài nghi những cách làm còn lại. Họ cho rằng nếu không có sự kiểm nghiệm khắt khe, khả năng chúng ta dự đoán một hành động có hiệu quả hay không là rất hạn chế.

Ngược lại, những người khác lại tin rằng các cơ hội tạo ra tác động lớn nhất thường nằm ở những cách tiếp cận mang tính thử nghiệm hoặc có yếu tố suy đoán nhiều hơn, ví dụ như nghiên cứu khoa học hay vận động chính sách. Chẳng hạn, các tổ chức như Forethought thực hiện những nghiên cứu có thể trở nên vô cùng giá trị nếu vài năm tới thế giới diễn biến theo một hướng nhất định. Nếu không, nghiên cứu đó có thể chẳng giúp ích được gì. Dù xác suất thành công có thể rất nhỏ, tác động tiềm tàng của nó lại lớn đến mức được xem là có "giá trị kỳ vọng" (expected value) cao.

Trên cục diện toàn xã hội, chúng ta rõ ràng cần đến sự kết hợp của cả hai hướng tiếp cận này.

Ngay cả sau khi đã đóng thuế, nhiều người trong chúng ta vẫn cảm thấy mình còn đủ khả năng và mong muốn được giúp đỡ người khác.

Chúng ta cũng cần nhìn nhận rằng, chính phủ không thể hoặc sẽ không giải quyết được hết mọi vấn đề. Ví dụ, thế giới không hề có một loại thuế tái phân phối toàn cầu, dù cho bất bình đẳng giữa các quốc gia còn lớn hơn nhiều so với bất bình đẳng trong lòng mỗi nước.

Hơn nữa, Thiện nguyện Hiệu quả không ra lệnh cho bạn phải làm gì. Cộng đồng này ở đây để giúp đỡ thêm, và khi bạn đọc đến đây, tức là chính bạn có thể giống chúng tôi, đã quan tâm và quyết định rằng bạn muốn cống hiến nhiều hơn.

Không. Nhưng khả năng thành công cao hơn thì tốt hơn, nếu giữ nguyên các yếu tố khác.

Một số người có sở thích mạnh mẽ đối với các phương pháp có bằng chứng thực nghiệm vững chắc và hoài nghi về những phương pháp không có. Điều này là do họ nghĩ rằng chúng ta có khả năng rất hạn chế trong việc dự đoán hành động nào sẽ hiệu quả và hành động nào sẽ không nếu không có thử nghiệm nghiêm ngặt.

Nhưng những người khác lại nghĩ rằng các cơ hội có tác động cao nhất sẽ liên quan đến các phương pháp thử nghiệm hoặc 'mang tính suy đoán' nhiều hơn, chẳng hạn như nghiên cứu khoa học hoặc vận động chính trị. Ví dụ, Viện Tương lai Nhân loại (Future of Humanity Institute) nghiên cứu những cách hiệu quả nhất để giảm thiểu các rủi ro thảm họa có thể ảnh hưởng rất tiêu cực đến toàn bộ nhân loại. Ngay cả khi chỉ có một cơ hội thành công nhỏ, tác động tiềm năng lớn đến mức nó có giá trị kỳ vọng cao.

Trong toàn xã hội, rõ ràng cần có sự kết hợp của cả hai.

Bạn không nên quyên góp đến mức đẩy bản thân vào hoàn cảnh khó khăn. Tuy nhiên, hãy nhớ rằng so với mặt bằng chung của thế giới, hầu hết chúng ta đều giàu hơn mình tưởng. Bạn có thể tính thử xem mình giàu đến mức nào so với phần còn lại của thế giới tại đây.Ví dụ, nếu bạn sống ở Mỹ và có thu nhập 30.000 USD/năm sau thuế, thu nhập của bạn vẫn cao gấp 9 lần mức thu nhập trung vị toàn cầu. Kể cả khi bạn quyên góp 10%, bạn vẫn có thu nhập cao gấp 8 lần mức trung vị đó (con số này đã được điều chỉnh theo sức mua tương đương). Điều này cũng đúng với người dân ở các quốc gia phát triển khác.

Ngoài ra, có rất nhiều cách để giúp đỡ mọi người mà không cần đến tiền bạc, chẳng hạn như lựa chọn một con đường sự nghiệp có sức ảnh hưởng lớn hơn.

Tìm hiểu thêm:

Xem vị trí của bạn trên thang thu nhập toàn cầu

Cách tạo tác động bằng sự nghiệp của bạn

Nhiều người cho rằng ý tưởng cố gắng tối đa hóa những điều tốt đẹp mình làm là một điều hiển nhiên và không có gì phải bàn cãi. Tuy nhiên, hầu hết mọi người lại không chủ động lựa chọn cách làm hiệu quả nhất có thể.Họ hoặc là không dành nhiều tâm sức để giúp đỡ người khác, hoặc chỉ chọn làm những gì mình thấy hứng thú, chứ không thực sự nghiên cứu và so sánh các phương án trước khi quyết định.

Dù vậy, nếu bạn thấy “thiện nguyện phải hiệu quả” là điều hiển nhiên, thì tuyệt vời! Rất có thể bạn sẽ thích tham gia cùng cộng đồng chúng tôi.

Có rất nhiều dự án không thể kể hết!

Bạn có thể tham khảo một vài ví dụ về các hoạt động của Thiện nguyện hiệu quả tại đây:

- Các tổ chức từ thiện về sức khỏe toàn cầu hiệu quả được giới thiệu bởi GiveWell.

- Các tổ chức từ thiện vì động vật hiệu quả được giới thiệu bởi Animal Charity Evaluators.

- Nhiều tổ chức đa dạng trong các lĩnh vực khác nhau đã nhận tài trợ từ Open Philanthropy.

- Các dự án được hỗ trợ bởi Các Quỹ Thiện nguyện hiệu quả (Effective Altruism Funds) trong bốn hạng mục chính: sức khỏe và phát triển toàn cầu, phúc lợi động vật, tương lai dài hạn, và "cơ sở hạ tầng" (hỗ trợ các dự án EA tiếp cận nguồn nhân tài, vốn và tri thức).

Hãy xem trang tác động.

Cộng đồng Thiện nguyện Hiệu quả được xây dựng bởi một tập thể thân thiện, đầy nhiệt huyết, thú vị từ khắp nơi trên thế giới. Tham gia cộng đồng mang lại nhiều lợi thế hơn so với khi hoạt động đơn độc.

Hợp tác: Bạn sẽ có cơ hội hợp tác với nhiều người tài năng trong các dự án của mình.

Tạo ảnh hưởng: Những góp ý và phê bình xây dựng của bạn có thể ảnh hưởng đến cộng đồng, giúp mọi người cùng áp dụng những phương pháp mà bạn cho là hiệu quả hơn.

Cộng hưởng nguồn lực: Bạn có thể chung tay góp sức cùng mọi người để thực hiện những nghiên cứu chung, giúp tất cả chúng ta tìm ra cách tạo ra tác động lớn hơn.

Học hỏi không ngừng: Bạn sẽ học hỏi được rất nhiều qua việc trò chuyện và trao đổi với các thành viên khác.

Nguồn động lực: Thật tuyệt vời và là nguồn động lực to lớn khi có những người bạn, cộng sự cùng chung lý tưởng.

Tuy nhiên, bạn hoàn toàn có thể giúp đỡ người khác một cách hiệu quả mà không cần tham gia cộng đồng. Nếu bạn tự mình tạo ra những đóng góp giá trị cho một vấn đề quan trọng, điều đó đã rất tuyệt vời rồi! Ngay cả khi không tham gia, bạn vẫn có thể tham khảo việc đưa ra một cam kết cá nhân (take a pledge) để giữ vững quyết tâm giúp đỡ mọi người của mình.

Khám phá thêm những gì bạn có thể làm tại trang Hành động.

Trước đây, cộng đồng đã từng mắc sai lầm khi bị đồng nhất một cách quá chặt chẽ với chiến lược “kiếm tiền để cho đi” (earning to give).Nhiều người trong cộng đồng vẫn cho rằng đây là một chiến lược phù hợp với một số người, đặc biệt là những ai có năng lực và phù hợp với công việc lương cao.

Tuy nhiên, quyên góp không phải là cách duy nhất để tạo ra tác động lớn. Nhiều người thậm chí có thể đóng góp tốt hơn bằng cách dùng chính sự nghiệp của mình để giúp đỡ người khác trực tiếp. Và cũng có nhiều người trong cộng đồng kết hợp cả hai.

Chúng tôi vẫn tin rằng việc quyên góp cho đúng tổ chức từ thiện là một trong những cách bạn có thể tạo ra sự thay đổi lớn lao. Đây cũng là một phương pháp có nền tảng bằng chứng tương đối vững chắc, vì đã có sẵn các nghiên cứu trước đó để kế thừa và phát triển.

Tìm hiểu thêm:

Làm thế nào để tạo tác động qua sự nghiệp của bạn

Làm thế nào để giúp người khác qua việc quyên góp hiệu quả

Bạn có nên "kiếm tiền để cho đi"?

Một số ví dụ về lập luận phản biện:

Lisa Herzog trên openDemocracy

Jennifer Rubenstein trên Boston Review

Sam Earle and Rupert Read trên the Ecologist

Những người theo Chủ nghĩa vị lợi thường rất ủng hộ Thiện nguyện hiệu quả. Tuy nhiên, nhiều người trong cộng đồng Thiện nguyện hiệu quả lại không phải là người theo Chủ nghĩa vị lợi; họ coi trọng những giá trị tự thân khác ngoài phúc lợi, chẳng hạn như quyền con người, sự tự do, bình đẳng, hay đức hạnh cá nhân. Trên thực tế, hầu hết chúng ta đều cân nhắc đến nhiều học thuyết đạo đức khác nhau khi hành động.

Yêu cầu đạo đức duy nhất của Thiện nguyện Hiệu quả là niềm tin rằng "giúp đỡ người khác là một việc quan trọng". Phong trào này không nhất thiết cho rằng làm mọi thứ có thể để giúp người khác là một nghĩa vụ bắt buộc, và cũng không cổ xúy việc vi phạm quyền của bất kỳ ai, ngay cả khi điều đó có thể mang lại kết quả tốt đẹp nhất.

Tìm hiểu thêm: Phân biệt Thiện nguyện Hiệu quả và Chủ nghĩa vị lợi (The difference between effective altruism and utilitarianism)

Ví dụ về lập luận phản biện này:

- Bài viết của Iason Gabriel trên Boston Review

- Bài viết của Catherine Tumber trên Boston Review

Một số người cho rằng Thiện nguyện hiệu quả quá chú trọng vào các giải pháp chắp vá (band-aid solutions) như can thiệp y tế trực tiếp, mà không thực sự giải quyết các nguyên nhân mang tính hệ thống sâu xa hơn của các vấn đề toàn cầu. Nhiều người tin rằng chủ nghĩa tư bản không được kiểm soát, bất bình đẳng giàu nghèo, văn hóa tiêu dùng hay bùng nổ dân số góp phần đáng kể vào sự đau khổ trên thế giới, và mọi nỗ lực cải thiện thế giới mà không giải quyết các nguyên nhân gốc rễ này đều là vô nghĩa hoặc sai lầm.

Đọc Đúng là Thiện nguyện hiệu quả quan tâm đến những phương pháp đã được "chứng thực" hiệu quả, chẳng hạn như nhân rộng các biện pháp can thiệp y tế đã qua kiểm nghiệm khắt khe. Đây là một tiêu chuẩn so sánh tốt để chúng ta đánh giá các cách tiếp cận khác mang tính suy đoán hơn. Tuy nhiên, khi kỹ năng đánh giá của cộng đồng ngày càng tốt hơn, nhiều người đang dần chuyển hướng sang các phương pháp liên quan đến thay đổi mang tính hệ thống.

Điều quan trọng cần nhớ là các quan điểm vẫn còn chia rẽ sâu sắc về việc liệu các hệ thống như toàn cầu hóa thương mại hay kinh tế thị trường là lợi bất cập hại hay ngược lại. Cũng không rõ liệu chúng ta có thể thay đổi các hệ thống này một cách triệt để mà không gây ra những hậu quả không mong muốn cực kỳ tồi tệ hay không.

Sự khác biệt về quan điểm này cũng được phản ánh ngay trong chính cộng đồng. Tinh thần của Thiện nguyện Hiệu quả là luôn cởi mở — chúng ta nên tránh việc trở nên giáo điều hoặc quá gắn chặt vào một hệ tư tưởng cụ thể nào. Mọi tuyên bố về cách tạo ra sự thay đổi đều cần được đánh giá dựa trên bằng chứng sẵn có. Nếu có một phương pháp nào đó có khả năng tạo ra một sự thay đổi tích cực ròng to lớn, chúng ta nên theo đuổi nó.

Đúng là nếu tất cả mọi người đều làm chính xác một việc và không bao giờ cập nhật quan điểm trước hoàn cảnh mới, thì điều đó sẽ gây ra vấn đề. Tuy nhiên, Thiện nguyện Hiệu quả đưa ra các khuyến nghị dựa trên những cơ hội tốt nhất hiện có, sau khi đã tính đến cả những việc mà người khác đang làm.

Khi ngày càng có nhiều người nắm bắt các cơ hội mà chúng tôi khuyến nghị, những lĩnh vực đó sẽ không còn bị xem nhẹ nữa, và giá trị của việc đầu tư thêm nguồn lực vào đó sẽ giảm dần. Khi đó, chúng tôi sẽ thay đổi khuyến nghị của mình để hướng đến các cơ hội khác. Kịch bản này hiện vẫn còn rất xa.

Tìm hiểu thêm: Giá trị của sự phối hợp - The value of co-ordination

Một số ví dụ về lập luận phản biện này: Gary Steuer Washington Post

Không. Nhưng khả năng thành công cao hơn thì tốt hơn, nếu giữ nguyên các yếu tố khác.

Một số người có sở thích mạnh mẽ đối với các phương pháp có bằng chứng thực nghiệm vững chắc và hoài nghi về những phương pháp không có. Điều này là do họ nghĩ rằng chúng ta có khả năng rất hạn chế trong việc dự đoán hành động nào sẽ hiệu quả và hành động nào sẽ không nếu không có thử nghiệm nghiêm ngặt.

Nhưng những người khác lại nghĩ rằng các cơ hội có tác động cao nhất sẽ liên quan đến các phương pháp thử nghiệm hoặc 'mang tính suy đoán' nhiều hơn, chẳng hạn như nghiên cứu khoa học hoặc vận động chính trị. Ví dụ, Viện Tương lai Nhân loại (Future of Humanity Institute) nghiên cứu những cách hiệu quả nhất để giảm thiểu các rủi ro thảm họa có thể ảnh hưởng rất tiêu cực đến toàn bộ nhân loại. Ngay cả khi chỉ có một cơ hội thành công nhỏ, tác động tiềm năng lớn đến mức nó có giá trị kỳ vọng cao.

Trong toàn xã hội, rõ ràng cần có sự kết hợp của cả hai.

Bản chất của Thiện nguyện hiệu quả là xuất phát từ mong muốn làm điều tốt, nhưng dùng lý trí và bằng chứng để định hướng hành động, nhằm đạt được hiệu quả cao nhất. Đúng là quá trình này đôi khi bao gồm việc tính toán mức độ hiệu quả của các hành động. Cũng đúng là chúng ta không phải lúc nào cũng quen biết những người mình đang giúp đỡ.

Hầu hết mọi người tìm đến Thiện nguyện hiệu quả vì họ có lòng trắc ẩn sâu sắc với mọi người, và tin rằng chúng ta nên giúp đỡ người khác bất kể có quen biết họ hay không. Và để giúp đỡ một cách hiệu quả nhất, việc tính toán đôi khi lại rất quan trọng.

Tìm hiểu thêm:

- Thiện nguyện hiệu quả: Lý tính chứ không vô cảm - Why effective altruism is calculating, but not cold

- Lòng trắc ẩn: Nguồn cảm hứng giúp đỡ những người xa lạ - How compassion can inspire us to help those we’ve never met

Một số ví dụ về lập luận phản biện này:

- Ken Berger & Robert Penna trên Stanford Social Innovation Review

- Emma Goldberg trên the New York Times

Một người nên cống hiến đến mức nào để cải thiện thế giới là một câu hỏi khó và rất riêng tư. Tuy nhiên, nhiều người quan tâm đến Thiện nguyện hiệu quả thường quyên góp từ 10% thu nhập trở lên, và/hoặc chuyển hướng sự nghiệp (shift your career path) để tạo ra tác động xã hội lớn hơn đáng kể.

Với một số người, điều đó nghe có vẻ là một sự hy sinh lớn lao. Nhưng với nhiều người khác, việc dành cả đời để cải thiện thế giới lại mang đến cho họ một mục tiêu rõ ràng và một lẽ sống mạnh mẽ. Thiện nguyện hiệu quả cũng mang đến một cộng đồng toàn cầu thân thiện để cùng nhau hợp tác. Việc nỗ lực giúp đỡ người khác nhiều nhất có thể đôi khi lại có mục đích, viên mãn và thậm chí vui vẻ hơn bất kỳ lựa chọn nào khác.

Bản thân sự hy sinh không có gì đáng mong muốn cả. Bạn chắc chắn không cần phải từ bỏ những điều làm mình hạnh phúc hay bỏ bê các mối quan hệ cá nhân. Mục đích ở đây là để giúp đỡ người khác, chứ không phải để tự dằn vặt bản thân.

Tìm hiểu thêm: Tầm quan trọng của việc cho đi trong hoan hỉ - The importance of giving cheerfully

Một số ví dụ về lập luận phản biện này: Tom Farsides trên The Psychologist

Nhiều người đồng tình rằng chúng ta nên nỗ lực tạo ra sự thay đổi, nhưng lại cho rằng ta nên dành tiền bạc và thời gian cho cộng đồng ngay tại địa phương mình.

Tất nhiên, việc giúp đỡ những người xung quanh, hay thậm chí là chính bản thân mình, không có gì là sai cả. Tuy nhiên, cơ hội để giúp đỡ những người ở nơi xa thường lớn hơn rất nhiều so với cơ hội giúp đỡ những người ở gần, đặc biệt là khi bạn đang sống ở một quốc gia phát triển.

Ví dụ, để huấn luyện một chú chó dẫn đường cho người khiếm thị ở Mỹ, chi phí vào khoảng 40.000 USD. Trong khi đó, chi phí để chữa khỏi bệnh đau mắt hột (một nguyên nhân gây mù lòa) ở một quốc gia đang phát triển chỉ từ 25 đến 50 USD. Điều này có nghĩa là, cũng với 40.000 USD đó, chúng ta có thể chữa khỏi bệnh mù lòa cho khoảng 400 đến 2000 người.

Tìm hiểu thêm: Vì sao những người ở nơi xa vẫn xứng đáng nhận được sự giúp đỡ - Why people far away still deserve our help

Một số ví dụ về lập luận phản biện này: David Brooks trên the New York Times

Đúng là có rất nhiều hoạt động từ thiện không hiệu quả, và có vô số ví dụ cho thấy các chương trình viện trợ và phát triển không mang lại tác động thực sự. Nhưng điều đó không có nghĩa là không tồn tại những tổ chức từ thiện đạt được các kết quả phi thường.

Thực tế, đó chính là lý do vì sao việc tìm ra những tổ chức tốt nhất, và dùng sự phán đoán sắc bén nhất của mình để xác định lĩnh vực nào đáng để chúng ta đầu tư thời gian và tiền bạc, lại quan trọng đến thế.

Bên cạnh đó, vẫn còn nhiều cơ hội khác để tạo ra tác động lớn, bao gồm cả khởi nghiệp kinh doanh, hoạt động chính sách, chính trị, vận động và nghiên cứu.

Tìm hiểu thêm:

Viện trợ đúng mục" tiêu: Hiệu quả không cần bàn cãi - The lack of controversy over well-targeted aid

Những lầm tưởng về hoạt động viện trợ - Myths about aid

Một số ví dụ về lập luận phản biện này: Angus Deaton trên Boston Review

Có một lập luận hợp lý rằng nếu các cá nhân ngừng quyên góp cho những tổ chức từ thiện hiệu quả nhất, thì các tổ chức từ thiện lớn hơn sẽ vào cuộc để lấp đầy khoảng trống đó. Nếu vậy, rốt cuộc, tác động của các khoản quyên góp cá nhân chỉ là giúp các tổ chức lớn "rảnh tay" hơn về mặt tài chính.

Đây là một câu hỏi khó trả lời. Một mặt, có khả năng nếu không có các nhà hảo tâm cá nhân, những nhà hảo tâm lớn hơn sẽ gánh vác một phần trách nhiệm. Mặt khác, nếu các tổ chức từ thiện lớn và hiệu quả được "giải phóng" khỏi các gánh nặng tài chính đó, họ có thể dùng nguồn lực để tài trợ cho những biện pháp can thiệp hiệu quả khác, kể cả những lĩnh vực quan trọng nhưng ít được các cá nhân ủng hộ.

Tuy nhiên, có những tổ chức từ thiện rất hiệu quả và hoàn toàn có khả năng tiếp nhận cũng như sử dụng hiệu quả nhiều ngân sách hơn nữa. Ví dụ, vào năm 2018, tổ chức GiveDirectly đã trao hơn 30 triệu USD cho những người nghèo nhất thế giới, và họ có thể trao nhiều hơn thế nữa nếu nhận được thêm tài trợ. Việc quyên góp cho các tổ chức còn thiếu hụt ngân sách lớn ít có khả năng làm lấn át các nguồn tài trợ khác.

Thế giới sẽ cần hàng trăm tỷ đô la để tài trợ cho các biện pháp can thiệp hiệu quả trong 15 năm tới. Khoảng trống này không thể được lấp đầy hoàn toàn chỉ bởi các quỹ lớn. Chẳng hạn, quỹ tài trợ của Good Ventures và Quỹ Gates lần lượt chỉ vào khoảng 8 tỷ - $8bn và 41 tỷ - $41bn USD.

Như đã đề cập, nếu bạn hoài nghi về việc quyên góp từ thiện, vẫn còn nhiều cách khác để bạn áp dụng các nguyên tắc của Thiện nguyện hiệu quả nhằm tạo ra sự thay đổi, chẳng hạn như lựa chọn một lĩnh vực sự nghiệp có tác động lớn.

Một số ví dụ về lập luận phản biện này: Iason Gabriel

Nguy cơ chúng ta không thực sự thấu hiểu và giải quyết đúng nhu cầu của những người mình đang giúp đỡ là có thật, và chúng ta phải luôn cảnh giác với rủi ro này. Nếu không lắng nghe và thấu hiểu người thụ hưởng, chúng ta sẽ kém hiệu quả đi, điều này hoàn toàn trái ngược với mục tiêu của chúng ta.

Một số người ủng hộ tổ chức GiveDirectly vì họ trao tiền mặt trực tiếp cho người nghèo, để người dân hoàn toàn tự quyết định cách sử dụng số tiền đó. Cách làm này có thể trao quyền cho người dân tốt hơn là việc áp đặt các dịch vụ mà có thể cộng đồng địa phương không thực sự mong muốn.

Các tổ chức khác mà chúng tôi hỗ trợ thì cung cấp các dịch vụ y tế cơ bản, như tiêm chủng hay bổ sung vi chất. Đây là những điều tốt đẹp một cách rõ ràng đến mức gần như chắc chắn người thụ hưởng sẽ trân trọng chúng. Sức khỏe tốt hơn có thể tiếp thêm sức mạnh để người dân tự cải thiện hoàn cảnh của mình theo những cách mà chúng ta, với tư cách là người ngoài cuộc, không thể làm thay được.

Trong những trường hợp khác, chúng tôi có thể tiến hành các đánh giá tác động chi tiết để xem người thụ hưởng thực sự cảm thấy thế nào về dịch vụ mà chúng tôi cung cấp. Tất nhiên, các cuộc khảo sát này không phải lúc nào cũng đáng tin cậy, nhưng đó thường là điều tốt nhất chúng ta có thể làm.

Với những đối tượng không thể nói lên tiếng nói của mình như động vật hoặc các thế hệ tương lai, vấn đề này còn phức tạp hơn nữa. Khi đó, mọi người phải cố gắng hết sức để dự đoán xem họ/chúng sẽ muốn gì nếu có thể giao tiếp với chúng ta. Những trường hợp hiển nhiên có thể kể đến như: lợn không muốn bị nhốt cả đời trong 'chuồng ép heo nái' chật hẹp, hoặc các thế hệ tương lai không muốn kế thừa một hành tinh mà con người không còn có thể dễ dàng sinh sống.

Tìm hiểu thêm:

Làm sao để không trở thành "vị cứu tinh da trắng"? (Bài học về phức cảm cứu thế) - How not to be a “white in shining armour”

Một số ví dụ về lập luận phản biện này:

Angus Deaton trên Boston Review

Jennifer Rubenstein trên Boston Review

Cecelia Lynch trên CIHA

Một số hành động chúng tôi khuyến nghị là những hành động đã được kiểm nghiệm và chứng tỏ có tác động lớn. Nhưng cũng có nhiều hành động có vẻ đầy hứa hẹn mà không khả thi để đánh giá bằng các phương pháp thực nghiệm như thử nghiệm đối chứng ngẫu nhiên. Tuy nhiên, một khi đã có bằng chứng chất lượng cao, chúng tôi luôn xem xét chúng một cách rất nghiêm túc.

Nhiều tổ chức được truyền cảm hứng từ Thiện nguyện hiệu quả cũng đang thực hiện các dự án "mang tính suy đoán" hơn, những dự án mà tác động của chúng rất khó để định lượng. Ví dụ, Open Philanthropy Project hoạt động trong các lĩnh vực như cải cách nhập cư, cải cách tư pháp hình sự, kinh tế vĩ mô và phát triển quốc tế.

Tìm hiểu thêm:

Vì sao việc so sánh các tổ chức từ thiện lại phức tạp - Why comparing charities is complex

Một số ví dụ về lập luận phản biện này:

Emily Clough trên the Boston Review

Pascal-Emmanuel Gobry Gobry trên The Week

Cộng đồng thiện nguyện hiệu quả hưởng lợi nhiều điều từ việc đa dạng hơn. Ban đầu, cộng đồng này chủ yếu hình thành từ những người ở các quốc gia phát triển và các trường đại học hàng đầu. Tuy nhiên, khi ngày càng phát triển, cộng đồng đang thu hút thêm nhiều thành viên từ các hoàn cảnh khác nhau. Chúng tôi rất vui mừng khi thấy các hội nghị EA được tổ chức tại nhiều thành phố trên khắp thế giới, từ Singapore cho đến Abuja, Nigeria.

Xét về mặt quan điểm và lối sống, chúng tôi lại rất đa dạng. Có người ăn chay, có người không. Nhìn chung, cộng đồng mang tính phi tôn giáo, nhưng vẫn có những thành viên theo các tôn giáo khác nhau. Các quan điểm chính trị cũng rất phong phú.

Dù nhiều người có những quan điểm và giá trị vững chắc, chúng tôi luôn đề cao việc xây dựng một cộng đồng biết tôn trọng sự khác biệt và sẵn sàng lắng nghe những lời phê bình. Điều gắn kết tất cả chúng tôi là niềm đam mê chung: giúp đỡ người khác nhiều nhất có thể.

Tìm hiểu thêm:

Quan điểm của Trung tâm Thiện nguyện hiệu quả (CEA) về sự đa dạng và hòa nhập - Centre for effective altruism’s stance on diversity and inclusion